【TDengine 使用环境】

预生产环境

【TDengine 版本】

3.3.3 社区版本

【操作系统以及版本】

PRETTY_NAME=“Ubuntu 24.04.2 LTS”

NAME=“Ubuntu”

VERSION_ID=“24.04”

VERSION=“24.04.2 LTS (Noble Numbat)”

VERSION_CODENAME=noble

ID=ubuntu

【部署方式】非容器部署

【集群节点数】

5

【集群副本数】

2

【遇到的问题:问题现象及影响】

流计算产生的中间状态不会自动删除,半个月数据量达到300G

创建流的时候指定了 DELETE_MARK 1d

【资源配置】

【报错完整截图】

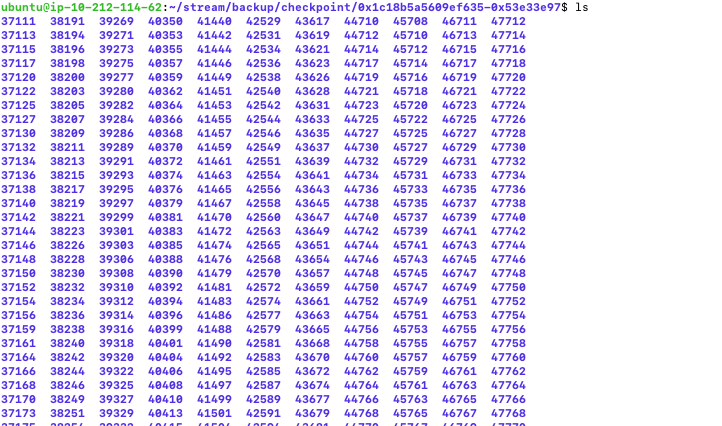

其中一个流的数据checkpoint信息

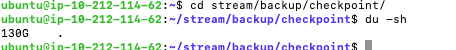

这是总数据量

这种状态我应该怎么处理减少占用过多的存储